Nvidia, yapay zeka odaklı data merkezleri için geliştirdiği Rubin platformunu resmen duyurdu. Şirketin mevcut Blackwell mimarisine kıyasla 5 kata varan performans artışı sunan Rubin, Nvidia’nın bugüne kadar geliştirdiği en kapsamlı ve en güçlü yapay zeka platformu olarak konumlanıyor.

Nvidia, yapay zeka odaklı data merkezleri için geliştirdiği Rubin platformunu resmen duyurdu. Şirketin mevcut Blackwell mimarisine kıyasla 5 kata varan performans artışı sunan Rubin, Nvidia’nın bugüne kadar geliştirdiği en kapsamlı ve en güçlü yapay zeka platformu olarak konumlanıyor. Altı farklı çipten oluşan dev platform

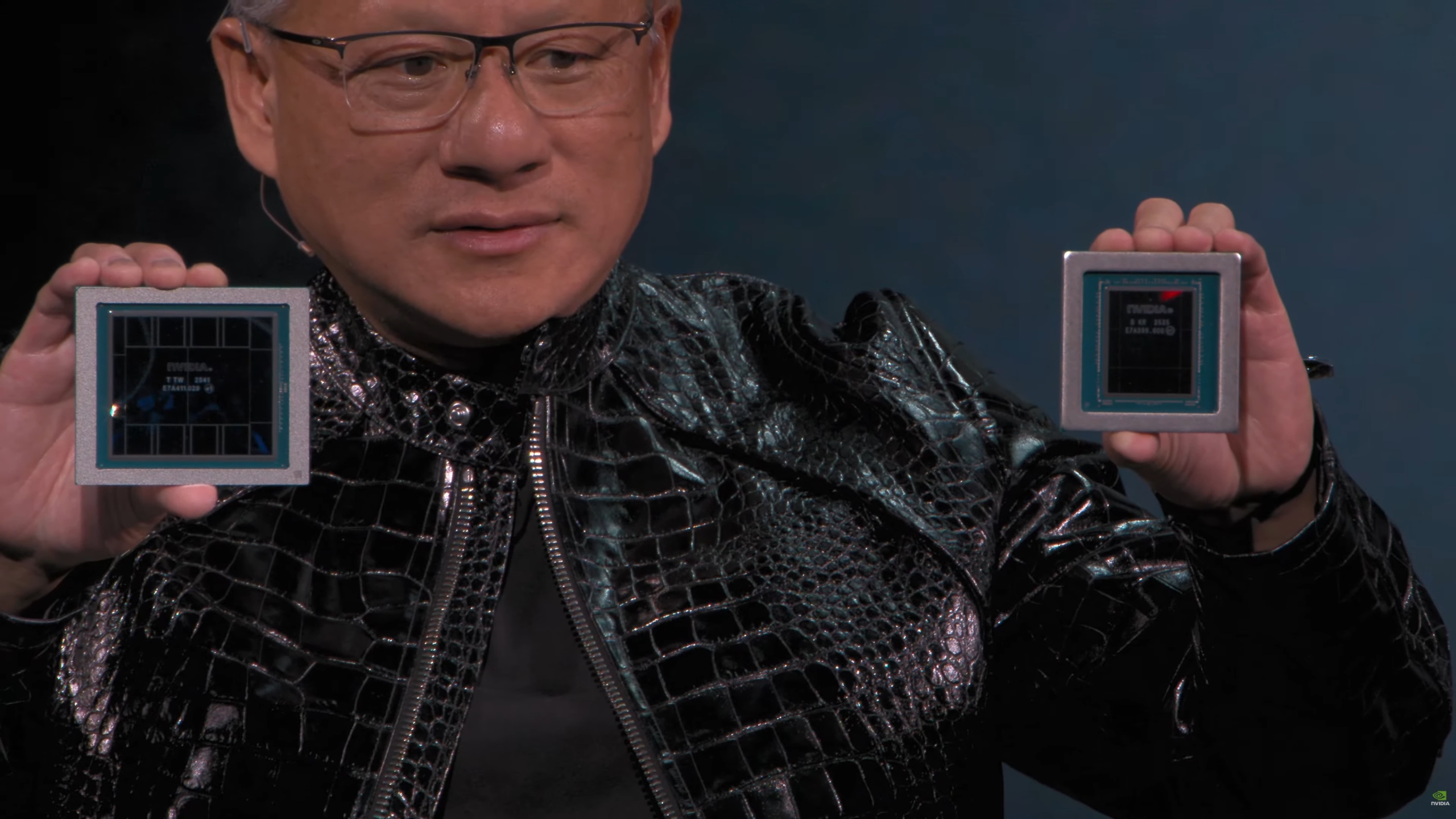

Rubin platformu, üretimden çıkmış ve Nvidia laboratuvarlarında test basamağında olan toplam altı farklı çipten oluşuyor. Bu bileşenler Rubin GPU, Vera CPU, NVLink 6 Switch, ConnectX-9 ve BlueField-4 ağ tahlilleri ile Spectrum-X 102.4T CPO silikon fotonik altyapısından oluşuyor. Tüm bu bileşenler DGX, HGX ve MGX sistemlerinde birlikte çalışacak halde tasarlandı.

Rubin platformu, üretimden çıkmış ve Nvidia laboratuvarlarında test basamağında olan toplam altı farklı çipten oluşuyor. Bu bileşenler Rubin GPU, Vera CPU, NVLink 6 Switch, ConnectX-9 ve BlueField-4 ağ tahlilleri ile Spectrum-X 102.4T CPO silikon fotonik altyapısından oluşuyor. Tüm bu bileşenler DGX, HGX ve MGX sistemlerinde birlikte çalışacak halde tasarlandı.  Bilgi merkezlerinin merkezinde ise Nvidia Vera Rubin Superchip yer alıyor. Bu harika çip, iki Rubin GPU, bir Vera CPU ve yüksek kapasiteli HBM4 ile LPDDR5x bellek yapılandırmalarını bir ortaya getiriyor.

Bilgi merkezlerinin merkezinde ise Nvidia Vera Rubin Superchip yer alıyor. Bu harika çip, iki Rubin GPU, bir Vera CPU ve yüksek kapasiteli HBM4 ile LPDDR5x bellek yapılandırmalarını bir ortaya getiriyor. Rubin GPU

Rubin GPU, her biri bağımsız süreç ve tensor çekirdeklerine sahip iki kalıplı dizaynla geliyor. Yapay zeka iş yükleri için özel olarak geliştirilen bu GPU, NVFP4 formatında 50 PFLOPs çıkarım ve 35 PFLOPs eğitim performansı sunuyor. Bu kıymetler, Blackwell’e kıyasla sırasıyla 5 kat ve 3,5 kat artış manasına geliyor.

Rubin GPU, her biri bağımsız süreç ve tensor çekirdeklerine sahip iki kalıplı dizaynla geliyor. Yapay zeka iş yükleri için özel olarak geliştirilen bu GPU, NVFP4 formatında 50 PFLOPs çıkarım ve 35 PFLOPs eğitim performansı sunuyor. Bu kıymetler, Blackwell’e kıyasla sırasıyla 5 kat ve 3,5 kat artış manasına geliyor. Bellek tarafında ise Rubin GPU, HBM4 teknolojisine geçiş yapıyor. Çip başına 22 TB/s bellek bant genişliği sunan bu yapı, Blackwell’e nazaran 2,8 kat artış sağlıyor. Ayrıyeten her CPU için 3,6 TB/s NVLink bant genişliği sunuluyor ve bu da evvelki jenerasyonun iki katı düzeyinde.

Vera CPU

Rubin platformunun işlemci tarafında yer alan Vera CPU, Nvidia’nın özel olarak geliştirdiği Olympus kod isimli yeni kuşak Arm mimarisine dayanıyor. Toplam 88 çekirdek ve 176 iş parçacığı sunan bu işlemci, Nvidia Spatial Multi-Threading teknolojisini kullanıyor.

Rubin platformunun işlemci tarafında yer alan Vera CPU, Nvidia’nın özel olarak geliştirdiği Olympus kod isimli yeni kuşak Arm mimarisine dayanıyor. Toplam 88 çekirdek ve 176 iş parçacığı sunan bu işlemci, Nvidia Spatial Multi-Threading teknolojisini kullanıyor. Vera CPU 1,8 TB/s NVLink-C2C dengeli bellek irtibatı, 1,5 TB sistem belleği (Grace’e nazaran 3 kat artış) ve 1,2 TB/s LPDDR5x bellek bant genişliği ile dikkat çekiyor. Tüm bu yapı, data sürece, sıkıştırma ve CI/CD iş yüklerinde Grace mimarisine kıyasla 2 kat performans artışı sağlıyor. Ayrıyeten platform, raf ölçeğinde bilinmeyen hesaplama dayanağı sunuyor.

NVLink 6 ve ağ altyapısı

Rubin platformunda kullanılan NVLink 6 Switch, 400G SerDes altyapısı sayesinde CPU başına 3,6 TB/s tümden tüm irtibat bant genişliği sağlıyor. Toplamda 28,8 TB/s ağ kapasitesine ulaşan bu anahtarlar, 14,4 TFLOPS FP8 ağ içi süreç gücü sunuyor ve büsbütün sıvı soğutmalı olarak tasarlanmış durumda.

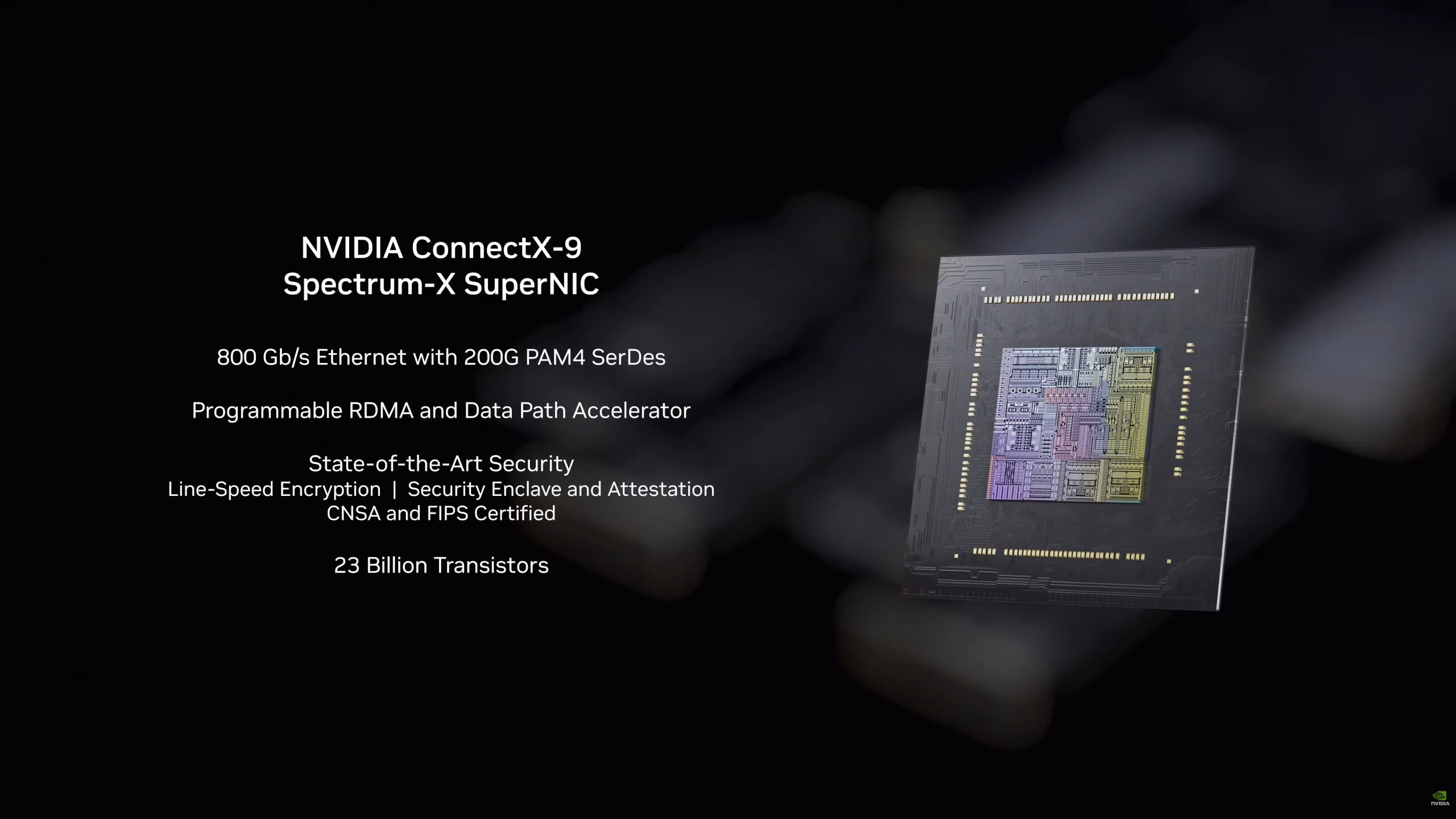

Ağ tarafında ConnectX-9 SuperNIC, 1,6 TB/s bant genişliği, 200G PAM4 SerDes, programlanabilir RDMA ve gelişmiş güvenlik özellikleriyle öne çıkıyor. BlueField-4 DPU ise 64 çekirdekli Grace CPU’yu ConnectX-9 ile entegre ederek evvelki jenerasyona kıyasla 2 kat ağ, 6 kat işlem ve 3 kat bellek bant genişliği sunuyor.

NVL72 raf sistemi sonları zorluyor

Nvidia’nın bu tüm ögeleri tek bir platformda, yani Nvidia Vera Rubin NVL72 raf sisteminde bir ortaya geliyor. Bu yapı, Blackwell tabanlı sistemlere nazaran 5 kat NVFP4 çıkarım (3,6 EFLOPS) ve 3,5 kat NVFP4 eğitim performansı (2,5 EFLOPS) sağlıyor. Bellek tarafında LPDDR5x kapasitesi 54 TB, HBM4 kapasitesi 20,7 TB düzeyine çıkarken HBM4 bant genişliği 1,6 PB/s ile 2,8 kat artış sunuyor. Ölçekleme bant genişliği ise 260 TB/s ile iki katına ulaşıyor.

Nvidia, Rubin ile birlikte Spectrum-X Ethernet Co-Packaged Optics tahlilini de duyurdu. 102,4 Tb/s ölçeklenebilir anahtarlama altyapısı sunan bu sistem, 200G silikon fotonik entegrasyonu sayesinde ölçek altında %95 aktif bant genişliği sağlıyor. Nvidia’ya nazaran bu tahlil 5 kat verimlilik, 10 kat güvenilirlik ve 5 kat daha yüksek uygulama çalışma müddeti sunuyor.

Rubin SuperPOD için tanıtılan Inference Context Memory Storage platformu ise gigaskala çıkarım senaryolarına odaklanıyor ve Dynamo, NIXL ve DOCA üzere Nvidia yazılım tahlilleriyle tam entegre çalışıyor. Nvidia, Rubin platformunu 8 adet NVL72 raf içeren yeni kuşak DGX SuperPOD sistemlerinde konumlandırırken daha geniş bilgi merkezleri için DGX Rubin NVL8 seçeneğini de sunacak.

Nvidia’ya nazaran Rubin platformu, Blackwell GB200’e kıyasla çıkarım token maliyetini 10 kat, MoE model eğitiminde kullanılan GPU sayısını ise 4 kat azaltıyor. Geniş bir iş ortağı ekosistemiyle desteklenen Rubin platformu halihazırda tam üretim kademesinde bulunuyor ve birinci müşterilerin çipleri bu yıl içinde teslim almaya başlaması planlanıyor.

Bir yanıt yazın